|

|

Nº 68 | OCTUBRE 2025 ISSN: 1139-1979 | E-ISSN: 1988-5733 © 2025. E. Universidad de Sevilla |

Cómo citar: Sbeghen Hoff, R. y de Lima Barbosa, C. (2025). Educação midiática e jornalismo na era da Inteligência Artificial: um olhar sobre casos de desinformação por meio de imagens e áudios. Ámbitos. Revista Internacional de Comunicación, (68),72-90. https://doi.org/10.12795/Ambitos.2025.i68.04

Educação midiática e jornalismo na era da Inteligência Artificial: um olhar sobre casos de desinformação por meio de imagens e áudios

Alfabetización mediática y periodismo en la era de la Inteligencia Artificial: una mirada a casos de desinformación a través de imágenes y audio

Rafael Sbeghen Hoff

Universidade Federal do Amazonas | Avenida General Rodrigo Octávio 6200, Coroado I Manaus | Brasil

0000-0003-4745-5689 | rafael.hoff@yahoo.com.br

0000-0003-4745-5689 | rafael.hoff@yahoo.com.br

Cristiane de Lima Barbosa

Universidade Federal do Amazonas | Avenida General Rodrigo Octávio 6200, Coroado I Manaus | Brasil

0000-0003-0358-4462 | crisb.jor@gmail.com

0000-0003-0358-4462 | crisb.jor@gmail.com

Recepción 05/05/2025 · Aceptación 09/07/2025 · Publicación 15/10/2025

Resumo

O objetivo deste artigo é discutir aspectos de intersecção entre a Educação Midiática e o Jornalismo no combate à desinformação, em especial aquela que utiliza a Inteligência Artificial para produção de conteúdos falsos. Nessa perspectiva, o procedimento metodológico escolhido foi o estudo de caso, com análise de conteúdo aplicada sobre dois acontecimentos de manipulação de conteúdo por IA midiatizados: o primeiro de representação imagética do Papa em uma jaqueta estilo puffer e o segundo de manipulação de áudio simulando declaração do prefeito de Manaus (Brasil). Foram estabelecidas relações críticas sobre as implicações dessas práticas e o exercício pleno da cidadania e da democracia. Para tanto, partimos de conceitos-chave como desinformação e Educação Midiática, ethos jornalístico e Inteligência Artificial, até chegarmos aos parâmetros éticos e pedagógicos do jornalista em sua práxis profissional. Como resultados, a partir da análise de duas manipulações produzidas com IA generativa, apontamos que a Educação Midiática, exercida pelo Jornalismo, deve instrumentalizar para a leitura crítica dos conteúdos, interesses e consequências dessa desinformação junto ao público prosumidor. Apontamos, ainda, a necessidade de investimentos na educação formal e informal para o desenvolvimento de práticas, popularização de ferramentas e estratégias de combate à desinformação como diminuição do risco às sociedades democráticas contemporâneas.

Palabras clave: inteligência artificial, jornalismo, desinformação, educação midiática, democracia.

Abstract

The aim of this article is to discuss aspects of the intersection between Media Education and Journalism in the fight against disinformation, especially that which uses Artificial Intelligence to produce false content. From this perspective, the methodological procedure chosen was a case study, with content analysis applied to two events of content manipulation by mediated AI: the first an image representation of the Pope in a puffer jacket and the second audio manipulation simulating a statement by the mayor of Manaus (Brasil). Critical relationships were established about the implications of these practices and the full exercise of citizenship and democracy. To this end, we started with key concepts such as disinformation and Media Education, journalistic ethos and Artificial Intelligence, until we reached the ethical and pedagogical parameters of the journalist in their professional praxis. As a result, based on the analysis of two manipulations produced with generative AI, we point out that Media Education, exercised by Journalism, must provide the tools to critically read the contents, interests and consequences of this disinformation for the prosumer public. We also point to the need to invest in formal and informal education to develop practices, popularize tools and strategies to combat disinformation like a risk to contemporary democratic societies.

Keywords: artificial intelligence, journalism, misinformation, media education, democracy.

1. Introdução

Em tempos de Inteligência Artificial (IA) e desinformação, o jornalismo assume um papel crucial na sociedade. Na atualidade, mais de 57 % do conteúdo disponível na internet é gerado por IA, conforme aponta estudo conduzido por pesquisadores da Amazon Web Services e publicado pela revista Forbes (Exame, 2024). As ferramentas de IA generativa podem ser consideradas perigosas se usadas com a intenção de desinformar, devido a rápida disseminação e a dificuldade de verificação da veracidade desses conteúdos, o que colabora também com a fragilização sobre a credibilidade dos jornalistas e dos veículos mais tradicionais da mídia.

Em contraponto a isso, os conteúdos com discurso de ódio foram reduzidos no Facebook em mais de 50 % nos últimos dois ou três anos, graças a filtros automáticos de IA, conforme afirmou o presidente dos assuntos internacionais da Meta, Nick Clegg, em 2024. O anúncio foi divulgado na mídia e ocorreu durante um evento organizado pelo centro de estudos britânico Chatham House sobre o tema: “Poderá a democracia sobreviver ao ritmo da tecnologia?”. Outro exemplo, citado pelo gestor, foi a remoção automática de 99,8 % do conteúdo relacionado com o grupo terrorista Estado Islâmico (EI) “antes de ser denunciado” (RTP, 2024). Vale ressaltar que, após a vitória de Donald Trump na corrida presidencial dos Estados Unidos, o dono do Facebook, Mark Zuckerberg, retirou (Helder et al, 2025) esses filtros e contribuiu, novamente, para a disseminação dos discursos de ódio na plataforma, transferindo a responsabilidade de filtragem e/ou verificação das informações ao internauta.

Diante deste cenário, há a necessidade de formar novos profissionais de comunicação, e em especial de Jornalismo, para atuarem com o fenômeno das informações (inclusive imagéticas) produzidas por IA. Nesse sentido, a Base Nacional Comum Curricular (BNCC), documento governamental brasileiro que rege os conteúdos a serem contemplados por cada matéria em cada ano do ensino formal, padronizando as competências e habilidades, saberes e referências de todos os estudantes no país, inclui desde os anos finais do ensino fundamental até o terceiro ano do ensino médio a Educação Midiática. O documento editado pelo governo brasileiro para orientar as ações nessa linha preconiza:

a educação para mídias passa a ir além do olhar para a recepção e análise crítica da informação. Como os usuários agora são também produtores e compartilhadores de conteúdo, eles desenvolvem novas competências ao usar dispositivos tecnológicos no cotidiano. Assim, torna-se necessário abranger também a relação dialógica produção-consumo em um contexto de convergência midiática. (Secom, 2023)

Entre as competências elencadas como fundamentais para o exercício pleno da cidadania em ambientes digitais, o governo brasileiro considera a formação para a “leitura e participação crítica na experiência com as mídias” um dos caminhos de atuação de universidades, comunicadores e educadores. Aqui, há uma clara referência à intersecção entre esses dois campos de conhecimento – a Educação e a Comunicação -, tratada nesse artigo como um espaço emergente e urgente de ações por parte dos profissionais das duas áreas, em prol da formação cidadã.

Diversos são os temas que afetam e são tomados como objeto de estudo por pesquisadores (Citelli, 2024; Munari et al 2024; Teixeira & Nunes, 2024) que se interessam nesse espaço de intersecção: a ubiquidade dos dispositivos móveis mediando as relações interpessoais (inclusive em sala de aula); a necessidade de uma alfabetização midiática voltada para a crítica às modelações e performatividades exigidas (impostas) por Big Techs aos usuários do mundo todo; a necessária regulação das mídias no país, imputando corresponsabilidade às empresas criadoras e administradoras sobre os conteúdos difundidos em suas plataformas digitais; entre outros.

Exemplo dessa relação entre o Estado Democrático de Direito, a democracia e a necessária Educação Midiática é exposta pelo texto de Bruno Ferreira:

as informações que acessamos, produzimos ou difundimos contribuem decisivamente para formar nossa visão de mundo. Se produzimos informações sem mensurar as consequências de nossas intenções ou se não sabemos avaliar fontes de informação, identificando sua confiabilidade ou intenção enganosa, podemos contribuir para que outras pessoas tomem decisões com base em interpretações equivocadas da realidade, o que afeta diretamente o exercício da cidadania numa sociedade democrática. (Ferreira, 2023, p.2)

Nessa perspectiva, o objetivo deste artigo é discutir aspectos de intersecção entre a Educação Midiática e o Jornalismo no combate à desinformação, em especial aquela que utiliza da Inteligência Artificial para produção de conteúdos falsos. A Educação Midiática, então, é tida como um conteúdo programático a ser adotado de maneira pontual na formação dos estudantes de jornalismo que, depois, poderão atuar também na formação cidadã de jovens estudantes da rede regular e formal de ensino. Tomamos por procedimento metodológico o estudo de caso, a partir de dois acontecimentos de manipulação de conteúdo por IA, midiatizados, passíveis de serem tomados como elementos empíricos para as reflexões de cunho teórico esboçadas neste artigo. O primeiro trata da imagen do Papa Francisco vestindo uma jaqueta estilo puffer e o outro aborda a manipulação em áudio atribuída ao prefeito de Manaus-AM em um período pré-eleitoral. Procuramos estabelecer relações críticas sobre as implicações dessas práticas e o exercício pleno da cidadania e da democracia. Para tanto, partimos de conceitos-chave para a discussão, tais como desinformação e Educação Midiática, ethos jornalístico, Inteligência Artificial, até chegarmos aos parâmetros éticos e pedagógicos do jornalista.

A pergunta que norteia esse estudo consiste em: Como a Educação Midiática pode preparar cidadãos e jornalistas para mitigar os impactos da desinformação gerada por ferramentas de Inteligência Artificial no exercício da cidadania e da democracia?

Como procedimento metodológico, a pesquisa qualitativa explorou dois exemplos de manipulação, um de imagem estática e outro de áudio, ambas produzidas com ferramentas de IA generativa, que circularam na internet, notadamente, relacionadas à desinformação. Os pesquisadores aplicaram a Análise de Conteúdo (Herscovitz, 2007) sobre o material publicado por diferentes canais digitais, jornalísticos ou não, procurando descrever e discutir esses objetos empíricos no cotidiano e na cultura midiática. Segundo Herscovitz (2007),

a análise de conteúdo revela-se como um método de grande utilidade na pesquisa jornalística. Pode ser utilizada para detectar tendências e modelos na análise de critérios de noticiabilidade, enquadramentos e agendamentos. Serve também para descrever e classificar produtos, gêneros e formatos jornalísticos, para avaliar as características da produção de indivíduos, grupos e organizações, para identificar elementos típicos, exemplos representativos e discrepâncias e para comparar o conteúdo de diferentes mídias em diferentes culturas. (p.123)

Com esse procedimento metodológico eleito para a construção do artigo, passamos a destacar dois conteúdos midiáticos como amostra representativa e, a partir de suas descrições, passamos a identificar características e discorrer sobre o tratamento a ser empregado sobre o material desinformacional.

2. Jornalismo: práticas para a confiabilidade

No campo do Jornalismo, a prática da verificação e checagem de fatos e dados não é uma novidade, mas por vezes fica obliterada em nome da “confiabilidade” das fontes e/ou da produção em escala industrial da notícia. Não raro, vemos assessorias de imprensa produzindo releases com dados imprecisos ou distorcidos em nome dos interesses de seus assessorados. De outro lado, as redações cada vez mais enxutas são expostas às lógicas da comunicação digital, exigindo uma atualização de conteúdos contínua e uma diversidade de linguagens em seus produtos, sobrecarregando os poucos profissionais que permanecem vinculados às empresas jornalísticas ou, mais recentemente, a grande massa subordinada à plataformização do trabalho.

No jornalismo, a plataformização opera na precarização dos vínculos de trabalho e no redesenho das rotinas produtivas, muda os processos de trabalho e dá prevalência às lógicas da monetização das audiências. Menospreza-se o saber especializado e o profissional torna-se ‘produtor de conteúdo’, ‘gestor de redes sociais’, analista de redes sociais’, ‘social media’ entre outras denominações (FIGARO et.al., 2021). A jornada de trabalho é ampliada e intensificada porque o mesmo profissional é multitarefa, produz ao mesmo tempo para mídias diferentes: impresso, online, redes digitais, atendendo aos diferentes affordances de cada plataforma. Monitora redes digitais para pautar as ‘notícias’, a apuração exige também o conhecimento do tratamento de dados e mineração de dados. (Nicoletti & Figaro, 2022, p. 4-5)

Tudo isso em um mercado cada vez mais competitivo, onde a abertura e manutenção de um portal de notícias na web pode sobreviver exclusivamente a partir de verbas governamentais e estratégias de clickbait, diminuindo a autonomia e o exercício da crítica em nome de uma “assessoria” travestida de Jornalismo.

Cabe diferenciar os dois termos: checagem e verificação de dados. A checagem, via de regra, acontece a priori, ou seja, na medida em que o jornalista coleta os dados, checa a fonte e a veracidade dos mesmos antes de sua publicação. Verificação, em contrapartida, acontece a posteriori, ou seja, depois que uma informação é divulgada por uma fonte em algum veículo ou perfil, cabendo ao jornalista checar se aquela informação é verdadeira e o nível de confiabilidade das fontes depois que ela se torna pública.

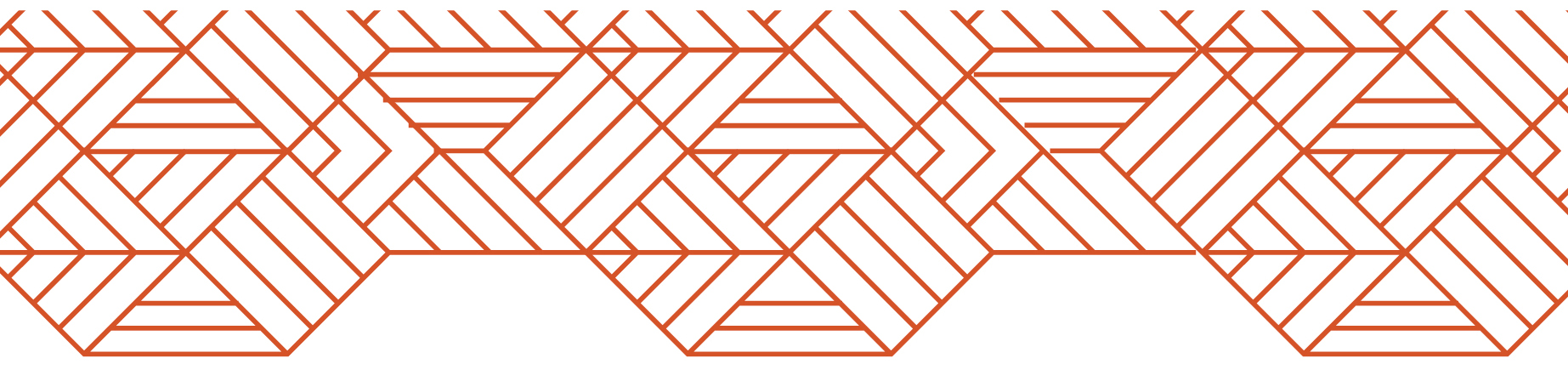

A diretora de pesquisa do First Draft, Claire Wardle (2017), publicou em seu clássico texto Fake News. It’s complicated sete tipos de desinformação, sintetizadas na Figura 1 e adotadas nesse texto como elementais para entendermos o fenômeno. São elas: falsa conexão; falso contexto; manipulação de conteúdo; sátira ou paródia; conteúdo enganoso; conteúdo impostor; conteúdo fabricado.

Figura 1

Tipos de desinformação segundo Wardle

Para a pesquisadora, ao estudarmos o fenômeno da desinformação, além dessa tipologia proposta, é preciso atentar para as motivações que fazem alguém criar esse tipo de conteúdo e as formas como esses conteúdos circulam nos ambientes digitais. Essas instâncias de investigação, transformadas em perguntas, orientam o processo de checagem e verificação de dados e contribuem, de forma direta, para a credibilidade do trabalho jornalístico e seus canais de difusão. O trabalho pode incluir ferramentas de Inteligência Artificial a serviço dessa checagem e verificação.

Empresas como a Undetectable AI e o Google oferecem recursos (Vision AI) para gerar imagens a partir de textos, “humanizar” conteúdos gerados por IA ou detectar probabilisticamente se um determinado material disponibilizado na web foi gerado com esse recurso. Há também ferramentas gratuitas, disponíveis na web, com o mesmo propósito, como o caso do AI or Not da empresa Optic. Apesar de apresentarem resultados positivos na detecção de origem das imagens, os verificadores não avançam na mesma velocidade e capacidade dos geradores de imagens, o que ainda traz instabilidade e insegurança no uso desses serviços por parte dos profissionais.

No caso dos jornalistas em formação, essa demanda (domínio de ferramentas e técnicas de detecção de conteúdos gerados por IA) parece ser ainda distante de matrizes curriculares construídas a partir de diretrizes governamentais e/ou burocracias institucionais que não respondem às demandas mercadológicas.

Os atravessamentos políticos e econômicos das práticas midiáticas e educacionais se entrelaçam no cotidiano das pessoas. Essas interrelações, que podem passar despercebidas pelos olhares menos atentos, são objeto de estudos na interseccionalidade da Comunicação com a Educação há muito tempo. E seus reflexos são sentidos nas interações, dentro e fora da sala de aula, principalmente a partir das sociabilidades mediadas por Tecnologias de Informação e Comunicação (TIC) digitais.

Com o desenvolvimento acelerado das tecnologias no século XX, especialmente com a convergência das mídias, as sociedades desenvolveram formas surpreendentes de armazenar, recuperar e disseminar informações. As ações das TICs em muito modificaram as formas e os conteúdos das percepções, pensamentos e interações na sociedade. O que pensamos e como pensamos se expressa em bens, serviços, produção material e intelectual, sejam alimentos, moradia, sistemas de transporte e comunicação, saúde ou educação. Assim, a integração crescente entre mente e máquina vem alterando fundamentalmente o modo pelo qual nascemos, vivemos, trabalhamos, produzimos e consumimos. (Rosa & Cecílio, 2010, p.109)

Além do trabalho jornalístico, há uma emergente discussão mundial sobre a necessária regulação das empresas que administram as plataformas digitais operando pelo planeta (Meta, X, Amazon, Google, Apple, etc), chamadas de Big Techs. Essas empresas valem-se da falta ou fragilidade nas legislações dos países onde atuam para se eximirem da responsabilidade sobre os conteúdos compartilhados por seus usuários. Um dos exemplos mais recentes foi a proibição de operação do X (de Elon Musk) no Brasil por falta de um representante legal da empresa (que pudesse responder legalmente por ela). E essa não é uma realidade exclusiva do país:

De acordo com novo relatório da Unesco, mais de 85 % das pessoas estão preocupadas com o impacto da desinformação online e 87 % acreditam que esta já prejudicou a política do seu país, de acordo com o inquérito global. Em todos os 16 países, 68 % dos entrevistados disseram que as mídias sociais eram onde as notícias falsas eram mais difundidas, à frente das aplicações de mensagens (38 %). (Ferrari, 2024, p.104)

Muito já se avançou no sentido de responsabilizar as empresas e os usuários sobre infrações e crimes cibernéticos no Brasil, a exemplo da criação da lei Carolina Dickmann (Lei 12737 de 30 de novembro de 2012). Após ter as fotos íntimas da atriz vazadas na internet, a legislação que leva seu nome foi criada imputando como crime a divulgação de conteúdo na web sem autorização expressa da pessoa detentora dos direitos autorais (materiais e intelectuais) de conteúdos como fotos e vídeos. Mas ainda há muito para ser aprimorado na legislação.

Sem a tipificação de crime na produção e difusão de conteúdo desinformacional, bem como no aparelhamento das instâncias estatais responsáveis pela investigação, o combate a essas práticas se torna difícil. Exemplo disso são as investigações em curso pela Polícia Federal sobre o chamado “Gabinete do Ódio”. Nos gabinetes do poder executivo federal, servidores e prestadores de serviço em cargo comissionado, ou seja, pagos com o dinheiro público, utilizaram a máquina estatal (como, por exemplo, a Agência Brasileira de Inteligência) para coletar e difundir informações falsas, distorcidas, indicar inimigos e ações do governo ou acobertar fatos com o intuito de favorecer a gestão de Jair Messias Bolsonaro (2019-2022).

Desse exemplo podemos inferir que a desinformação é uma prática lucrativa, organizada e intencionalmente dirigida. Produz conteúdos em diferentes linguagens, sob diferentes formatos, com o intuito de direcionar a leitura sobre fatos, personagens e dados (verdadeiros ou não).

2.1. Desinformação e Inteligência Artificial

A circulação de notícias falsas como instrumento de disputa de poder não é um fenômeno novo (Lellis & Moreira, 2019). No entanto, as plataformas por onde tais informações circulam, ao longo do tempo, sofreram grandes alterações. Hoje, com as mídias sociais digitais, o alcance em larga escala é instantâneo e eleva os perigos dessa prática a um outro patamar.

Plataformas como Facebook, Twitter e Whatsapp favorecem a replicação de informações mal apuradas, de boatos e mentiras intencionais. Grande parte do conteúdo compartilhado vem de conhecidos, pessoas em quem os usuários confiam. A aparente proximidade dos influenciadores aumenta o verniz de legitimidade das falsas histórias. Um exemplo concreto são os algoritmos utilizados pela Meta (proprietária do Facebook, Instagram, WhatsApp, etc.), que direcionam para cada usuário as informações que reforçam os seus pontos de vista repertoriais ou ideológicos; um processo seletivo nefasto que produz bolhas com indivíduos similares e isola as narrativas gerais, polariza os questionamentos à esquerda ou à direita, sem ocorrer uma diversidade mínima de visões conjunturais ou de argumentos. (Teixeira & Nunes, 2024, p. 2)

Na contramão desse movimento de proliferação da desinformação por canais digitais, utilizando o capital social e simbólico de possíveis autores e/ou replicadores, surgiram as organizações de combate ao fenômeno. A utilização de algoritmos de aprendizado de máquina permite que as agências de fact-checking, por exemplo, processem grandes quantidades de informações em um curto período de tempo, identificando padrões e detectando possíveis falhas em declarações e informações divulgadas. Além disso, a Inteligência Artificial também pode ajudar a identificar a origem das informações falsas e a rastrear sua disseminação na internet. Qualquer usuário pode fazer uso desses serviços, gratuitamente, interagindo e compartilhando conteúdos suspeitos com essas agências.

Assim como a câmera fotográfica produz imagens a partir de efeitos óticos, químicos (no caso das películas) e/ou digitais, a partir das escolhas e regulagens do operator (Barthes, 1985; Flusser, 1986), os prompts e comandos enviados a uma IA também operam a partir da intervenção humana, mas mantém certa autonomia. Isso porque os algoritmos delineiam as formas de aprender por parte da máquina, mas são incapazes de assegurar com precisão o quê a máquina está aprendendo. “A Inteligência Artificial é uma tecnologia que busca simular a tomada de decisões e o comportamento humano para resolver problemas lógicos” (Faustino, 2023, s/p), ou seja, consiste em uma tecnologia que usa recursos para produzir diferentes conteúdos a partir da intencionalidade de quem programa ou gera o comando.

Nesse sentido, Robl Filho et al. (2022, p. 34) endossam que: “a Inteligência Artificial (IA), também vem sendo empregada para desinformar por meio das chamadas deep fakes, normalmente com o intuito de provocar desinformação, embora também esteja sendo amplamente utilizada para o humor e a sátira”. Diante da dificuldade em discernir entre o conteúdo genuíno (verídico) e aquele criado por IA e utilizado como desinformação, há de se reconhecer a importância da Educação Midiática para o uso ético e responsável das possibilidades digitais em contextos de sociabilidade mediada por Tecnologias de Informação e Comunicação digitais. Essa perspectiva é corroborada por Munari, Lindemann e Rebelo:

a literacia midiática emerge como uma competência fundamental para que esses cidadãos do amanhã possam navegar criticamente por esse ambiente complexo e multifacetado em direção à construção de uma sociedade mais igualitária. A importância da literacia midiática, entretanto, vai além do simples uso de tecnologias, sejam as digitais, sejam as analógicas. Aliás, é preciso dizer que as lacunas da literacia começam já na primeira escola, e têm sido exponenciadas pelas práticas com as novas mídias - ou com o distanciamento entre a proposição do letramento escolar e a realidade social pragmática. Assim, o conceito de literacia é expandido: trata-se de capacitar os alunos a interpretar, analisar e produzir conteúdos midiáticos de maneira crítica e responsável, entendendo os impactos sociais, culturais e políticos das mídias em seu sentido amplo. (Munari et al., 2024, p. 2)

Se a questão da Educação Midiática, também chamada de literacia midiática, é colocada como crucial no processo de educação formal, aqui se coloca em perspectiva o papel educativo das mídias, dos jornalistas e a missão social da academia em formar cidadãos capazes de duvidar e verificar a veracidade das informações postas em circulação. É dessa premissa que enfatizamos uma revisão do ethos jornalístico, a partir do seu papel pedagógico na sociedade. Esse ethos, por definição, trata da

imagem de si que o locutor constrói em seu discurso para exercer uma influência sobre seu alocutário. Essa noção foi retomada em ciências da linguagem e, principalmente, em análise do discurso no que se refere às modalidades verbais da apresentação de si na interação verbal. O “ethos” faz parte, como o “logos” e o “pathos”, da trilogia aristotélica dos meios de prova. Adquire em Aristóteles um duplo sentido: por um lado designa as virtudes morais que garantem credibilidade ao orador, tais quais a prudência, a virtude e a benevolência; por outro, comporta uma dimensão social, na medida em que o orador convence ao se exprimir de modo apropriado a seu caráter e a seu tipo social. Nos dois casos trata-se da imagem de si que o orador produz em seu discurso, e não de sua pessoa real. (Charadeau & Mainguenau, 2004, p. 220)

É dessa premissa que partimos para analisar os casos de manipulação imagética e sonora, com uso de Inteligência Artificial, e seus desdobramentos sobre o exercício da cidadania.

3. Estudos de caso sobre manipulação de imagem e som por IA

A pesquisadora Wardle (2017) já descreveu, em suas categorias de desinformação, alguns tipos que passam pela ação humana para uso indevido (no sentido ético), a partir de manipulações (como retirar do contexto), distorções (como selecionar e/ou forçar interpretações distorcidas sobre dados) e criação de conteúdo inverídico. Nessas categorias, fica evidente a intencionalidade de quem produz o conteúdo: atender a interesses privados em detrimento do interesse público. Quando esse material é posto em circulação no ambiente digital, geralmente a autoria e as fontes são omitidas ou inventadas, além de apresentarem textos imprecisos acompanhando imagens, gráficos e áudios.

O estudo de caso, como procedimento metodológico, segundo Chizzotti (2006):

é uma caracterização abrangente para designar uma diversidade de pesquisas que coletam e registram dados de um caso particular ou de vários casos a fim de organizar um relatório ordenado e crítico de uma experiência, ou avaliá-la analiticamente, objetivando tomar decisões a seu respeito ou propor uma ação transformadora. (p.102)

Esse procedimento será asociado à análise de conteúdo (Herscovitz, 2007), combinada com a leitura crítica sobre as práticas midiáticas de comunicação, passando pelas seguintes etapas: definição do universo de análise e seleção do universo amostral (imagem do Papa e áudio do prefeito de Manaus); seleção da unidade de análise (desinformação). Por meio dessa análise de conteúdo, foram definidas dez categorias analíticas para identificar as características apontadas em cada caso de manipulação por meio da IA generativa com propósito de desinformar: natureza do conteúdo; tecnologia utilizada; objetivo aparente; plataformas de disseminação; impacto social; facilidade de detecção; reação do público; riscos associados; questões éticas; e debate gerado.

3.1. O caso da imagem do Papa de jaqueta

O primeiro caso tomado como objeto nesse artigo, que circulou em todo o mundo, ocorreu em março de 2023. Uma imagem bastante realista do Papa Francisco vestindo um casaco estilo puffer (Figura 2) acionou Robl Filho et al. um alarme na mídia e nas redes de fotógrafos profissionais e amadores.

A repercussão ocorreu em março de 2023, quando uma imagem do Papa Francisco usando uma jaqueta branca viralizou nas redes sociais, levando muitos a acreditarem que se tratava de uma fotografia autêntica. Esse sentido de real / realidade (Jaguaribe, 2010) acionado a partir da imagem é reforçado pelo detalhamento na textura do tecido da jaqueta, pelos meios tons entre a parte iluminada e sombreada, pela coerência na direção da luz, pela falta de profundidade de campo que não permite ao espectador comparar a imagem do Papa com seu contexto, pelo semblante do personagem principal que não olha para a câmera, dando a entender que a fotografia teria sido registrada de maneira furtiva, casual, espontânea (associada ao flagrante no imaginário coletivo). Entretanto, a imagem foi criada por Pablo Xavier utilizando o MidJourney (uma Inteligência Artificial generativa que produz imagens a partir de comandos textuais do usuário). A imagem rapidamente ganhou atenção em plataformas como Reddit e Twitter antes de ser desmentida.

O caso destaca a vulnerabilidade do público e até mesmo de veículos jornalísticos perante conteúdos gerados por IA. A descoberta da imagem foi questionada após análises mais aprofundadas, mas não antes de ter influenciado debates sobre moda, religião e tecnologia. “O impacto não é casual, pois se trata de um processo significativo de tradução intersemiótica automática que, por meio de redes neurais específicas, transpõe o código textual para o código imagético” (Santaella, 2022, p. 43). Este evento ilustra como a desinformação visual pode ser amplificada pela rapidez das redes sociais, colocando em xeque a adição das fontes de informação.

Figura 2

Imagem do Papa Francisco produzida por IA

Fonte. Google Imagens, 2023.

Com todas as facilidades, esse tipo de geração de imagens via Inteligência Artificial pode representar possíveis deslocamentos de funções profissionais e até demissões, além de contínuos processos de rejeição, como já aconteceu nas redações durante o movimento de digitalização do equipamento e processamento de imagens fotográficas para o suporte digital. A tendência é que nada disso parece impedir que venha a ser, inevitavelmente, amplamente utilizada a Inteligência Artificial para a produção de conteúdos cada vez mais difíceis de diferenciação do material “genuíno” e factual. Afinal, como indica Burke (2017, p. 35): “As tentações do realismo, mais exatamente a de tomar uma imagem por realidade, são particularmente sedutoras no que se refere a fotografias e retratos”.

Talvez, uma das mudanças mais significativas no campo profissional do Jornalismo seja o aprimoramento de técnicas e uso de ferramentas digitais para a verificação e checagem de dados, incluindo a origem e a veracidade de imagens. Afinal, a credibilidade dos veículos, profissionais e do próprio campo em relação à infodemia vista no ambiente digital contemporâneo exigem uma postura de mediação entre o consumidor final das notícias e as mais variadas fontes (e suas intenções) na produção de conteúdos. “O fact-checking também pode ser considerado uma extensão do jornalismo profissional que, em tempos de controvérsia, auxilia a imprensa tradicional na delimitação do espaço de profusão de discursos verdadeiros” (Massarani et al., 2021, p. 32).

As agências se tornam uma alternativa de restabelecer e fortalecer a credibilidade jornalística. Porém, a interação com os usuários de plataformas e aplicativos no ambiente digital ainda se mostram como fluxo importante no combate à desinformação, pois deles partem denúncias, dúvidas e sugestões de leitura sobre acontecimentos e conteúdos midiatizados.

3.2. O caso do áudio do prefeito de Manaus gerado por IA

Outro exemplo significativo de desinformação gerada por IA ocorreu em Manaus, capital do Amazonas, no Brasil, em dezembro de 2023, quando houve a manipulação de um áudio imitando a voz do prefeito da capital, David Almeida, como apontado pela Figura 3. O caso ocorreu após uma manifestação de professores em frente à Prefeitura, e um áudio atribuído ao prefeito foi divulgado via grupos de conversação no Whatsapp no dia seguinte, supostamente insultando os docentes. A situação se tornou delicada porque no ano seguinte (2024) ocorreriam as eleições municipais, da qual o prefeito era forte concorrente à reeleição. Assim, esse cenário já se configurava como uma movimentação política para desestabilizar a imagem do gestor público diante da população. Diante disso, o prefeito denunciou à Polícia Federal a circulação do áudio falso que imitava sua voz.

A investigação foi iniciada e a Polícia Federal (PF) conseguiu provar tecnicamente que o material não era autêntico. A investigação policial identificou o sistema usado, quem produziu o áudio, o local de produção e apontou uma agência de publicidade como responsável pela divulgação e propagação do material em plataformas digitais (D24AM, 2024). O caso culminou em uma operação de busca e apreensão da Polícia Federal contra três empresas de publicidade suspeitas de usarem Inteligência Artificial para produzir difamação eleitoral. Segundo Queiroz (2024), este foi um dos primeiros usos de deep fake para distribuir desinformação com impacto no pleito de 2024 – um problema que pode inundar os tribunais durante as campanhas e ganhar protagonismo nas eleições futuras.

Figura 3

Exemplo de notícia que circulou na mídia sobre o desdobramento do caso

Fonte. Cenarium, 2024.

A tecnologia por trás da criação de vozes sintéticas está se tornando cada vez mais acessível, permitindo que qualquer pessoa gere imitações convincentes. Exemplos dessas ferramentas são o Play.ht, Murf.AI, Speechify, AnimakerVoice e Natural Reader, todos disponíveis na web. O impacto desse tipo de conteúdo é ainda mais profundo, pois explora a confiança que o público deposita em figuras públicas.

Nas palavras de Aguiar e Roxo (2019, p.182): “A desinformação associada a avanços tecnológicos poderá nos levar a um estágio de ‘infocalipse’ onde não saberemos mais distinguir o que é verdadeiro do que é falso, o que trará danos irreparáveis à democracia”.

Além de melhorar a imagem do prefeito, o caso revelou lacunas na capacidade de identificar e combater a desinformação em tempo hábil por parte dos jornalistas e da população em geral. Como desdobramento desse caso, após a denúncia formal à Polícia Federal pelo próprio prefeito, torna-se perceptível a necessidade de regulamentação e estratégias para proteger indivíduos e instituições da manipulação tecnológica.

Manaus não é um caso isolado. Para exemplificar, na cidade de Maringá, no norte do Estado do Paraná, por exemplo, houve também a manipulação de um áudio que circulou nas redes sociais simulando a voz do prefeito Silvio Barros (Progressistas). No áudio, o político supostamente abriria mão de concorrer ao pleito no ano de 2024. A Justiça concedeu liminar para que o WhatsApp, aplicativo da empresa Meta, identificasse o primeiro responsável por divulgar o conteúdo, mas a empresa disse que não é possível rastrear a mensagem (Queiroz, 2024).

Desses casos citados acima podemos tomar a dimensão do problema enfrentado pelo Estado e pelas organizações da sociedade civil em prol de uma regulamentação das operações de empresas multinacionais que operam dispositivos e artefatos da cultura digital em diferentes partes do mundo. Pereira e Faleiros Junior resumem a amplitude da questão sobre a chamada soberania digital:

a “soberania digital” não é um tema de relevância apenas para especialistas e que afeta somente pessoas que interajam com o meio digital. Pelo contrário, a soberania digital seria uma disputa geral em curso pelo controle dos dados, dos softwares, padrões, protocolos, processos, hardwares, serviços, e infraestruturas envolvendo o ambiente digital. (Pereira & Faleiros Junior, 2024, p. 4)

Essa soberania digital afeta diretamente as performances dos usuários e seus direitos básicos, uma vez que dados sensíveis podem ser coletados por essas grandes empresas, sem que haja clareza sobre seus usos ou sobre a segurança empregada na proteção deles. Isso para mencionar apenas dois aspectos problemáticos, entre tantos outros (autoria sobre as fontes utilizadas pela IA para geração de imagens, sons ou textos, para citar outro exemplo).

Um ponto de reflexão que cabe, diz respeito à credibilidade que sempre foi o maior capital simbólico do campo dos media, da imprensa, e talvez seu maior inimigo: a pós-verdade. O termo é utilizado desde a década de 1990 e com bastante frequência nos dias atuais. O Oxford Dictionaries elegeu a “Pós-verdade” como a palavra da língua inglesa, em 2016. O conceito consiste em um neologismo que descreve a situação na qual, na hora de criar e modelar a opinião pública, os fatos objetivos têm menos influência que os apelos às emoções e às crenças pessoais.

Uma reflexão importante sobre esses casos, é que em tempos de pós-verdade, a checagem de informações espalhadas nas mídias digitais e portais de notícias na internet tem sido uma prática adotada nas rotinas produtivas dos jornalistas e também aderida pela sociedade em busca de dados verdadeiros. Sendo assim, o jornalismo tem um importante papel na sociedade de esclarecer e mediar a relação entre o cidadão comum e os acontecimentos midiatizados.

Assim, com base na análise dos dois exemplos de produção de conteúdo falso por IA, uma tabela comparativa (Quadro 1) com a categorização científica das características dos casos mencionados:

Quadro 1

Características do uso da IA generativa nos casos

|

Característica do uso da IA generativa |

Imagem do Papa Francisco com jaqueta Balenciaga |

Áudio falso do prefeito de Manaus |

|

Natureza do conteúdo |

Imagem hiper-realista gerada por IA utilizando o MidJourney. |

Áudio falso sintetizado por IA imitando a voz de uma figura pública (prefeito). |

|

Tecnologia utilizada |

Redes neurais voltadas para geração de imagens (IA generativa). MidJourney. |

Modelos de síntese de voz baseados em aprendizado profundo (Deep Learning). |

|

Objetivo aparente |

Entretenimento e provocação de debates sobre moda, religião e tecnologia; sem intenção explícita de enganar. No entanto, algumas pessoas desinformadas acreditaram na imagem do papa, fora do contexto normal. Em razão do fundamentalismo religioso, causou bastante confusão. |

Manipulação política e desinformação, visando minar a credibilidade do prefeito e influenciar a opinião pública. |

|

Plataformas de disseminação |

Reddit, Twitter, e outras redes sociais de alcance global, tais como o Instagram. |

Aplicativos de mensagens instantâneas (Telegram, WhatsApp) e redes locais. Circulou também em alguns portais que não checam a informação antes de postar. |

|

Impacto social |

Desinformação visual que gerou debates globais sobre o papel da IA na arte e na moda, além de questões éticas. Impactou também na comunidade religiosa. |

Desinformação auditiva que prejudicou a confiança pública em uma figura política local e gerou desconfiança generalizada. A desinformação por aúdio é considerada uma “inovação” neste meio e as pessoas ainda não estão habituadas. |

|

Facilidade de detecção |

Análises detalhadas revelaram inconsistências na imagem, como mãos mal renderizadas. |

Mais difícil de detectar sem análise técnica aprofundada, devido à alta fidelidade da imitação vocal. |

|

Reação do público |

Inicialmente acreditada por muitos; foi amplamente desmentida após investigações e discussões na mídia. |

Causou confusão e indignação, levando o prefeito a desmentir publicamente o conteúdo. |

|

Riscos associados |

Amplificação de desinformação visual, questionamento da veracidade de imagens fotográficas no futuro. |

Erosão da confiança pública, polarização política e danos à reputação de indivíduos. Pode se tornar uma prática em pré-campanhas e durante as campanhas eleitorais, fortalecendo ainda mais a polarização e a cultura do ódio político. |

|

Questões éticas |

Exploração do realismo imagético como meio de entretenimento, mas com potencial de uso mal-intencionado. |

Uso deliberado para enganar e manipular, com implicações éticas mais graves devido ao impacto direto na democracia. |

|

Debate gerado |

Discussão sobre o papel da IA na arte e na cultura, além de impactos em profissões criativas. A Deep fake do líder da Igreja Católica ostentando uma jaqueta da Balenciaga foi publicado como se fosse real por perfis pop e veículos tradicionais. Especialistas discutem regulamentação da tecnologia e papel de comunicadores nessa abordagem. |

Preocupação com a segurança digital, regulação de IA e a proteção da democracia. Especialistas discutem regulamentação da tecnologia e papel de comunicadores nessa abordagem. Discussão sobre as instâncias jurídicas sobre penalidades para esse tipo de crime na internet. |

Fonte. Elaboração própria, 2024.

Em ambos os casos, o jornalismo profissional foi crucial para o esclarecimento sobre os casos e atualização de informações confiáveis, principalmente via web. Além de suscitar dúvidas sobre a veracidade, a imprensa também apontou a importância da constituição de métodos e ferramentas para a detecção de conteúdos manipulados por IA. O material jornalístico conseguiu mobilizar a sociedade civil organizada e instituições públicas em prol do problema, que em diferentes frentes produziu iniciativas para combater notícias falsas durante o pleito de 2022, por exemplo. Traquina (2004) aponta que o trabalho jornalístico, inserido no contexto de uma sociedade democrática, implica uma crença profissional em determinados valores, entre eles a liberdade, a objetividade e a busca por autonomia profissional e credibilidade. Dessa forma, o jornalismo deve agir com o objetivo de “equipar os cidadãos com as ferramentas vitais para o comprimento de seus direitos e voz na expressão das suas preocupações” (Traquina, 2004, p. 129).

A digitalização da informação e a Inteligência Artificial em ascensão chamou a atenção da Cúpula de Líderes do G20 que reconheceu o aceleramento “dramático” da escala e alcance da desinformação e do discurso de ódio online. Na reunião do G-20, realizada em novembro de 2024, no Rio de Janeiro (Brasil), a cúpula se comprometeu a “trabalhar” em prol de mais transparência e da responsabilidade das plataformas digitais, conforme o excerto:

(...) A digitalização do campo da informação e a evolução acelerada de novas tecnologias, como a inteligência artificial, impactaram dramaticamente a velocidade, a escala e o alcance da desinformação não intencional e intencional, discurso de ódio e de outras formas de danos online. Nesse sentido, enfatizamos a necessidade de transparência e responsabilidade das plataformas digitais, em linha com as políticas relevantes e os marcos legais aplicáveis, e trabalharemos com as plataformas e as partes interessadas pertinentes a esse respeito. A transparência, com as salvaguardas apropriadas, a explicabilidade sobre dados, algoritmos e moderação de conteúdo que respeitem os direitos de propriedade intelectual e a privacidade e a proteção de dados podem ser fundamentais para a construção de ecossistemas de informação saudáveis (...). – Declaração dos Líderes do Rio de Janeiro, 2024

Esta foi a primeira vez na história do G20, o Grupo de Trabalho de Economia Digital (DEWG, na sigla em inglês), criado em 2017, que foi apresentada uma declaração sobre combate à desinformação na internet. O grupo apontou em um dos relatórios desenvolvidos para a Cúpula de Líderes do G20 deste ano, uma série de riscos das informações falsas e afirmou que a “mentira e a desinformação não são novos para a humanidade, mas estão atingindo níveis que ofuscam e prejudicam o fluxo de informações confiáveis e precisas” (página 10). O documento ainda dedica um eixo à Inteligência Artificial, com três compromissos (números 77, 78 e 79).

O combate à desinformação foi listado dentro do eixo de “Inclusão social e combate à fome e à pobreza” (compromisso número 29). A redação diz que o grupo se compromete a “aproveitar o potencial das tecnologias digitais e emergentes para reduzir as desigualdades” e reconhece que “a inclusão digital requer conectividade universal e significativa”. A Cúpula também reconhece que as “plataformas digitais remodelaram o ecossistema digital e as interações online, amplificando a disseminação de informações e facilitando a comunicação dentro e além das fronteiras geográficas”.

4. Considerações finais

Os casos estudados revelam o impacto crescente das tecnologias de Inteligência Artificial no cenário de desinformação, tanto no âmbito visual quanto auditivo. Nesse sentido, a complexidade e a urgência de ações que integram a Educação Midiática e o Jornalismo na mitigação dos impactos da desinformação, especialmente aquela potencializada pelo uso de ferramentas de Inteligência Artificial foi a tônica deste artigo. Para tanto, o cenário atual demonstra como a IA generativa é capaz de transformar, em vários aspectos, a forma como se cria, consome e dissemina conteúdo digital, com consequências diretas para a sociedade e para a democracia.

Ao retornarmos à pergunta norteadora e a partir da análise dos casos propostos, confirma-se a hipótese de que há a crucial importância da Educação Midiática, exercida pelo Jornalismo, a fim de contribuir para a redução dos impactos negativos causados por manipulação de informações via IA generativa. Os dois casos trazidos neste estudo como exemplos – a imagem manipulada do Papa Francisco e o áudio falso atribuído ao prefeito de Manaus – ilustram como a desinformação gerada por IA se manifesta em contextos distintos, com motivações diversas, trazendo à sociedade impactos que variam de debates culturais e religiosos à manipulação política. Nos casos analisados, percebeu-se que as tecnologias de IA, se não reguladas e usadas de forma ética, podem minar a confiança nas instituições, comprometendo a reputação de figuras públicas e impactando sobre as políticas sociais.

A imagem gerada do Papa Francisco usando uma jaqueta estilo puffer e o áudio falso atribuído ao prefeito de Manaus exemplificam como os conteúdos podem ser associados ao Jornalismo como “embalagem” ou chancela para uma verossimilhança que remete à veracidade dos conteúdos. Porém, essa verossimilhança deve ser acompanhada, cada vez mais, de uma desconfiança por parte de jornalistas e empresas jornalísticas que defendem o compromisso com a ética e com a democracia. Os atos de verificação e checagem de dados são práticas que podem fazer uso de ferramentas digitais (incluindo dispositivos de Inteligência Artificial) para servir de caminho à Educação Midiática.

Ainda que as empresas visem o lucro e atendam aos interesses de patrocinadores e anunciantes, é preciso manter o viés de prestação de serviço de interesse público sobre as redações, onde a pluralidade de vozes e a representação do maior número de segmentos sociais se faça presente nas pautas e produtos jornalísticos. Se não é possível alcançar a isenção por ser um trabalho executado por seres sociais e políticos, a ação jornalística pode ao menos preservar a ideia de não ser detentora da verdade, mas apresentar uma interpretação possível sobre os fatos. Para além da metalinguagem sobre o campo do Jornalismo, é preciso discutir outros vieses e ambientes da comunicação digital nesse espaço.

As tensões se dão no âmbito do simulacro, da verossimilhança e no atendimento aos desejos e viés de confirmação dos internautas, em detrimento ao diálogo e à reflexão crítica. Somos convidados a interagir com entes queridos já falecidos, produzirmos artigos científicos para atender às métricas quantitativas dos órgãos avaliadores e regulatórios da pós-graduação, alimentar plataformas digitais com nossos dados, imagens, vozes, preferências e cotidiano. Esses dados, por sua vez, são comercializados pelas Big Techs sem que haja transparência sobre a aplicação destes, para citar apenas uma das controvérsias no processo de regulamentação das mídias sociais digitais aqui no país.

O professor e pesquisador Carlos Scolari (2015, apud Ferrari, 2024, p.107) aponta que “a literacia transmídia é entendida como um conjunto de capacidades práticas, valores, sensibilidades e estratégias de aprendizagem e treinamento construído e aplicado no contexto das novas culturas colaborativas”. Talvez um potencial investimento, configurando o papel das empresas midiáticas, esteja exatamente na propositura de espaços e conteúdos de combate à desinformação de maneira tão profissional quanto aquelas produzidas e postas em circulação na contemporaneidade. Pollyana Ferrari (2024) sintetiza:

Meios complexos onde a desinformação e a manipulação de conteúdos (deepfakes) se utilizam cada vez mais de componentes transmídiaticos, por meio de produtores de conteúdo humanos e não-humanos (avatares influencers), criados pelas atuais inteligências artificiais generativas (IAG) para ludibriar o leitor/ouvinte/ telespectador, pedem uma edição transmidiática antirracista e com componentes bem definidos de literacia. (p. 109)

O papel pedagógico do Jornalismo precisa ser tratado de maneira empresarial e acadêmica, com reforço nos conteúdos programáticos das disciplinas em atualizações de Planos Pedagógicos de Cursos. Sem essa preocupação da academia com as necessidades impostas pela dinâmica social e pelos avanços tecnológicos no âmbito da Comunicação, os cursos são direcionados à obsolescência, à desconexão entre mercado de trabalho e ambiente escolar, ecoando e amplificando uma dissonância entre aquilo que os estudantes percebem e vivenciam em seus smartphones e aquilo que é proposto pelas universidades - reposição de peças à grande engrenagem do mercado, sem a formação de profissionais capazes de refletir criticamente e colaborar com mudanças significativas no tecido social.

Em outro sentido, a formação de profissionais com uma visão crítica sobre a importância da Educação Midiática e do papel pedagógico do Jornalismo pode tensionar o mercado, exigindo que as empresas midiáticas abram espaço para esse tipo de conteúdo.

5. Declaración sobre la contribución específica de cada una de las autorías, según la taxonomía CrediT

- Concepción y enfoque del trabajo: Autores 1 y 2.

- Curación de datos: Autores 1 y 2.

- Análisis formal: Autores 1 y 2.

- Adquisición de fondos: No aplica.

- Investigación: Autores 1 y 2.

- Metodología: Autores 1 y 2.

- Administración del proyecto: Autor 1.

- Recursos: No aplica.

- Software: No aplica.

- Supervisión: Autor 1.

- Visualización: Autor 2.

- Redacción: Autores 1 y 2.

6. Declaración sobre uso de inteligencia artificial

En este artículo no se utilizó inteligencia artificial.

Semblanza de los/as autores/as

Rafael Sbeghen Hoff é professor do curso de Jornalismo da Universidade Federal do Amazonas, professor colaborador no Programa de Pós-Graduação em Informação e Comunicação (PPGIC-UFAM) e professor permanente no Programa de Pós-Graduação em Comunicação (PPGCOM-UFRR). Líder do Grupo de Pesquisa em Processos Imagéticos (PRIMA-UFAM), vice-líder do Grupo de Pesquisa em Estética e Processos Audiovisuais (ARTIS-UFRGS), pesquisador-bolsista Capes no Grupo de Ações e Investigações Autopoiéticas (GAIA-UFERSA).

Cristiane de Lima Barbosa é professora do curso de Jornalismo da Universidade Federal do Amazonas, professora permanente no Programa de Pós-Graduação em Informação e Comunicação (PPGIC-UFAM). Vice-líder do Grupo de Pesquisa Comunicação, Cultura e Amazônia (TROKANO-UFAM).

Referencias bibliográficas

Aguiar, L. De A., & Roxo, L. A. (2019). A credibilidade jornalística como crítica à “cultura da desinformação”: uma contribuição ao debate sobre fake News. Revista Mídia e Cotidiano, 13(3), 162-186. https://doi.org/10.22409/rmc.v13i3.38079

Barthes, R. (1984). A câmara clara: nota sobre a fotografia. Nova Fronteira.

Burke, P. (2017). Testemunha Ocular – O uso das imagens como evidência histórica. Editora Unesp.

Charadeau, P., & Maingueneau, D. (2004). Dicionário de análise do discurso. Contexto.

Chizzotti, A. (2006). Pesquisa em ciências humanas e sociais. Cortez.

Citelli, A. (2024). IAs: a educação e o tecnossolucionismo. Anais do 47º Congresso Brasileiro de Ciências da Comunicação. https://encurtador.com.br/gRBNE

Faustino, M. (2023) O que é inteligência artificial generativa e quais riscos ela representa no combate à desinformação. Aos Fatos. https://shre.ink/xdiH

Ferrari, P. (2024). A era do prompt: inteligência artificial, colonialismo, devires e desinformação. Fi.

Ferreira, B. (2023). 5 contribuições da Educação Midiática à Democracia. Instituto Palavra Aberta.

Flusser, V. (1985). Filosofia da caixa preta. Hucitec.

Fischer, R. M. B. (2002). O dispositivo pedagógico da mídia: modos de educar na (e pela) TV. Educação e Pesquisa, 28(1), 151-162.

G20. (2024). Declaração de líderes do G20. g20.org. Declaração de líderes do G20. https://shre.ink/xM5v

Helder, D., Salati, P., & Souza, V. (2025). Meta, dona do Instagram e Facebook, encerrará sistema de checagem de fatos para adotar ‘notas da comunidade’ como no X. G1. https://shre.ink/xdF4

Herscovitz, H. G. (2007). Análise de conteúdo em jornalismo. In C. Lago & M. Benetti, Metodologia de pesquisa em jornalismo. Vozes.

Jaguaribe, B. (2010). Ficções do real: notas sobre as estéticas do realismo e pedagogias do olhar na América Latina contemporânea. Ciberlegenda, 1(23), 6-14. http://dx.doi.org/10.22409/c-legenda.v1i23.25998

Lellis, M. B., & Moreira M. D. (2018). Percorrendo caminhos alternativos: um olhar sobre o jornalismo científico. Geminis, 9(3), 161-175. http://doi.org/10.4322/2179-1465.032

Mais de 57 % do conteúdo da internet é gerado por IA, aponta estudo. (2024, 5 de setembro). Exame. https://encurtador.com.br/hHaSf

Massarani, L., Brotas, A., Costa, M. C. R., & Neves, L. F. F. (2021). Vacinas contra a COVID-19 e o combate à desinformação na cobertura da Folha de S. Paulo. Fronteiras – estudos midiáticos, 23(2). https://doi.org/10.4013/fem.2021.232.03

Munari, A. C., Lindemann, C., & Rebelo, C. T. (2024). Literacia midiática: uma habilidade indispensável na educação. Anais do 47º Congresso Brasileiro de Ciências da Comunicação.

Nicoletti, J., & Figaro, R. (2022). Plataformização do trabalho dos jornalistas: uma outra face da precarização. In Anais do 20º Encontro Nacional de Pesquisadores em Jornalismo. https://encurtador.com.br/zoXWd

Pereira, L. D. A., & Faleiros Junior, J. L. de M. (2024). Regulação das plataformas digitais no Brasil e a defesa da soberania nacional. Revista de Ciências do Estado, 9(1), 1-22. https://doi.org/10.35699/2525-8036.2024.52248

Polícia Federal desarticula rede que criou áudio falso contra prefeito. (2024, 9 de setembro). Revista Cenarium. https://shre.ink/xM5Z

Projor. Manual de Jornalismo Local: Checagem e verificação. (2024). https://encurtador.com.br/2m5zk

Queiroz, G. (2024, 12 de agosto). IA pode ser uma ameaça no Brasil às vésperas da eleição. Portal DW.

Rosa, R., & Cecilio, S. (2010) Educação e o uso pedagógico das Tecnologias da Informação e Comunicação: a produção do conhecimento em análise. Educação em Foco, 15(1), 107-126.

Robl Filho, I. N., Marrafon, M. A., & Medon, F. (2022). A inteligência artificial utilizada para desinformar ou à serviço da desinformação: como as deepfakes e as redes automatizadas abalam o mercado livre de ideias e a democracia constitucional e deliberativa. Economic Analysis of Law Review, 13(3), 32-47. https://doi.org/10.31501/ealr.v13i3.12527

Santaella, M., & Kaufman, D. (2024). A inteligência artificial generativa como quarta ferida narcísica do humano. Matrizes, 18(1), 37-53. https://doi.org/10.11606/issn.1982-8160.v18i1p37-53

Secretaria de Comunicação Social da Presidência da República (SECOM) (2023). Estratégia Brasileira de Educação Midiática. https://shre.ink/xdRP

Teixeira, A. P. de M., & Nunes, V. C. (2024). Letramento digital e combate à desinformação: um programa socioprático para escolas públicas. Anais do 47º Congresso Brasileiro de Ciências da Comunicação.

Traquina, N. (2024). Teorias do Jornalismo, Volume 1 – porque as notícias são como são. Editora Insular.

Wardle, C. (2017). Fake News. It’s Complicated. First Draft Footnotes. https://encurtador.com.br/M9VRU